米実業家イーロン・マスク氏が設立した人工知能(AI)開発企業「xAI」が提供する「Grok」(グロック)によって、実在の人物が勝手に性的な加工をされ、その画像がX(ツイッター)上に数多く投稿される「性的ディープフェイク」の被害が世界中に広がっている。日本でも被害が報告されており、生成AIがもたらす深刻な問題へと発展している。

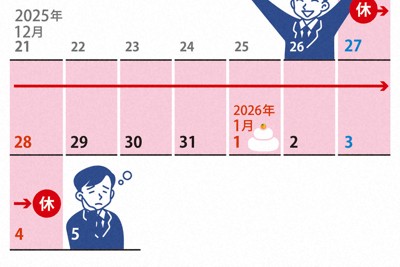

グロックはXの利用者が投稿のとき、タグ付けすると応答する「AIチャットボット」。昨年12月下旬ごろ、グロックに新たに画像編集機能が追加され、他人が投稿した写真であっても、テキストで指示を出すだけで簡単に改変できるようになった。

X上では今年に入り、投稿された女性の写真に対し、身につけている衣服をビキニや下着姿などに変更するような指示がグロックになされ、指示通り性的な画像が出力・投稿された事例が世界規模で確認されている。ほぼ全裸に見えるものや、男性がビキニ姿にされている画像などもある。

米メディアによると、未成年の女性をターゲットにしたものや、女性が身体を拘束されたり、顔に殴られたようなあざを追加されたりしたような加害的描写もいくつもあったという。

日本でも自分の写真を投稿したコスプレーヤーの女性らから、画像を改変されたという被害を訴える声が複数上がっている。

一方でマスク氏はX上で、自分に女性用ビキニを着せた画像を生成するようグロックに指示し、出来上がった生成画像に対して「パーフェクト」と、批判の声を意に介さないような投稿をしている。

毎日新聞はxAI社に対し、同社の見解や今後の対応などを問い合わせるメールを送ったが、「Legacy Media Lies」(レガシーメディアはうそをつく)という自動応答のメッセージが返ってきたのみだった。X社にも同様の内容を問い合わせているが、4日正午時点で返答はない。

欧米メディアによると、インド政府はXに是正を求める書簡を送付し、対応の報告を要求している。フランスの検察当局は、性的ディープフェイクの拡散について捜査を開始するとしている。【町野幸】

鄭重声明:本文の著作権は原作者に帰属します。記事の転載は情報の伝達のみを目的としており、投資の助言を構成するものではありません。もし侵害行為があれば、すぐにご連絡ください。修正または削除いたします。ありがとうございます。